AIの学習効率を劇的に変える「歩幅」の秘密とは?勾配降下法と学習率減衰

こんにちは。ゆうせいです。

あなたはAIの勉強をしていて、「数式ばかりでイメージが湧かないなあ」と感じたことはありませんか。

特に機械学習の基礎を学んでいると、必ずと言っていいほど登場する「勾配降下法」や「学習率」という言葉。

漢字が並んでいて少し難しそうに見えますが、実はこれ、私たちの日常生活にある「ある動作」に例えると驚くほど簡単に理解できるんです。

今回は、AIが賢くなるための重要なステップであるこれらの概念について、数式をなるべく使わずに、直感的なイメージで解説していきます。

この仕組みを知れば、AIがどのようにして正解に近づいていくのか、その裏側が手に取るようにわかるようになりますよ。

山登りならぬ「山下り」で理解する勾配降下法

まず、「勾配降下法」という言葉から紐解いていきましょう。

これは文字通り、「勾配(坂の傾き)」に従って「降下(降りていく)」する方法のことです。

想像してみてください。

あなたは今、真夜中の真っ暗な山の中に立っています。明かりはなく、周りの景色は全く見えません。

あなたのミッションは、この山のどこかにある「一番低い谷底」まで降りることです。

目隠しをされた状態で、どうやって一番低い場所を目指せばいいでしょうか?

おそらくあなたは、足先の感覚を頼りにするはずです。

「こっちに足を出したら下がっているな」と感じる方向へ、一歩足を踏み出しますよね。

そして、進んだ先でまた傾斜を確認し、さらに低い方へと進んでいくでしょう。

これを繰り返していけば、いつかは一番低い谷底に到着できるはずです。

機械学習の世界では、この「谷底」こそが「誤差が最も少ない状態(正解)」にあたります。

AIは現在の場所から、傾斜(勾配)を計算し、低い方へと少しずつパラメータを更新しているのです。

これが勾配降下法の正体です。

「学習率」は下山時の歩幅

さて、ここで一つ重要な決断が必要になります。

それは「一歩の大きさ(歩幅)」をどれくらいにするか、ということです。

この歩幅のことを、専門用語で「学習率」と呼びます。

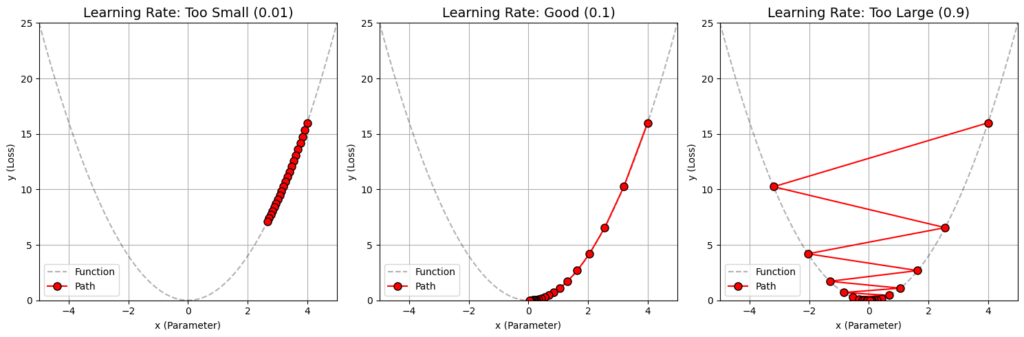

もし、あなたの一歩(学習率)が巨人並みに大きかったらどうなるでしょうか。

谷底へ向かっているつもりでも、勢い余って谷を飛び越え、向こう側の山へ登ってしまうかもしれません。

これでは、いつまで経ってもゴールである谷底には辿り着けませんよね。これを専門的には「発散」と呼んだりします。

逆に、一歩がアリのように小さすぎたらどうでしょう。

安全に降りることはできるかもしれませんが、谷底に着くまでに途方もない時間がかかってしまいます。

もしかしたら、ゴールする前に日が暮れて(時間切れになって)しまうかもしれません。

つまり、学習率というパラメータは、大きすぎても小さすぎてもうまくいかないのです。

「ちょうどいい歩幅」を見つけることが、AIの学習を成功させるための大きな鍵となります。

最初は大胆に、最後は慎重に

「じゃあ、最初から最後まで『ちょうどいい歩幅』で歩き続ければいいの?」と思いますよね。

もちろんそれも一つの手ですが、もっと賢い戦略があります。

それは、「最初は大きく踏み出し、ゴールが近づくにつれて小刻みに歩く」という方法です。

登山でも、頂上付近の長い下り坂は元気よく大股で下り、目的地周辺の入り組んだ道では慎重に歩幅を小さくしますよね。

機械学習でも同じように、学習の初期段階では学習率を大きく設定して一気に谷底付近まで近づき、学習が進むにつれて学習率を小さくして微調整を行う手法があります。

これを「学習率減衰(Learning Rate Decay)」と呼びます。

例えば、学習の回数(ステップ数)を としたとき、学習率を

のように設定したとします。

そうすると、回数を重ねるごとに分母が大きくなるため、学習率(歩幅)は自動的に小さくなっていきます。

最初は だった歩幅が、

、

...と徐々に小さくなり、最後はミリ単位の調整ができるようになるわけです。

この戦略のメリットと注意点

このように、状況に応じて歩幅を変える戦略には、明確なメリットと気をつけるべき点があります。

メリット

最大のメリットは、学習の「スピード」と「精度」を両立できることです。

最初は大きく進むので、大まかな正解付近まで素早く移動できます。

そして最後は小さく動くため、谷底の最も深いポイント(最適解)にピタリと止まりやすくなります。

ずっと大きな歩幅のままだと、谷底を行ったり来たりしてしまって、最後の最後で精度が出ないことがあるのですが、この方法ならその心配がありません。

デメリットと注意点

一方で、難しい点もあります。それは「歩幅を小さくするペース配分」です。

あまりに急激に歩幅を小さくしてしまうと、まだ谷底は遠いのに足が止まってしまい、中途半端な場所(局所解)で学習が終わってしまうことがあります。

逆に、小さくするのが遅すぎると、いつまでもウロウロして時間がかかってしまいます。

「どのような計算式で減衰させるか」を決めるのは、AIエンジニアの腕の見せ所でもあるのです。

今後の学習の指針

いかがでしたか。

「勾配降下法」や「学習率」という言葉を聞くと身構えてしまいますが、要は「暗闇での山下り」と「歩幅の調整」の話だったのです。

AIも私たちと同じように、試行錯誤しながら、最初は大胆に、最後は慎重に学習を進めていると思うと、少し親近感が湧いてきませんか。

今後の学習としては、実際にこの「学習率」を変更すると、AIの挙動がどう変わるのかを観察してみるのがおすすめです。

Pythonなどのプログラミング言語を使って、簡単なグラフを描画してみると、「歩幅が大きすぎて飛び跳ねている様子」や「小さすぎて進まない様子」が目に見えてわかります。

ぜひ、手を動かしてその「感覚」を掴んでみてくださいね!

セイ・コンサルティング・グループでは新人エンジニア研修のアシスタント講師を募集しています。

投稿者プロフィール