ディープラーニングの心臓部!初心者でもわかる活性化関数おすすめランキング5選

こんにちは。ゆうせいです。

ディープラーニングの心臓部!初心者でもわかる活性化関数おすすめランキング5選

活性化関数とは何か

みなさんは、人間の脳がどのように情報を伝えているか想像したことはありますか?私たちの脳細胞は、入ってきた刺激が一定の強さを超えたときだけ、次の細胞に電気信号を送ります。これと同じ役割をAIの世界で担っているのが、活性化関数です。

ニューラルネットワークにおいて、各層から計算されて出てきた数値は、そのままではただの数字の羅列に過ぎません。その数値を「次の層へどれくらい強く伝えるか」を判断するフィルターのような存在が活性化関数なのです。

もし活性化関数がなければ、AIは複雑な物事を理解することができません。まるで、どんなに強い光を当てても「オンかオフか」しか答えられないスイッチのような、単純な計算機になってしまいます。

専門用語の解説

ここで重要な用語、線形と非線形について説明しましょう。

高校の数学で習う直線のグラフを覚えていますか? y = ax + b という式で表されるような、真っ直ぐな線の関係を線形と呼びます。対して、複雑に曲がった線を非線形と言います。

活性化関数は、計算結果にこの非線形という魔法をかける役割を持っています。これにより、AIは「猫の耳の形」や「声のトーン」といった、直線では表現できない複雑な特徴を捉えられるようになるのです。

活性化関数ランキング

それでは、現在のアマチュアからプロの開発現場まで幅広く使われている活性化関数を、使いやすさと性能の観点からランキング形式で紹介します!

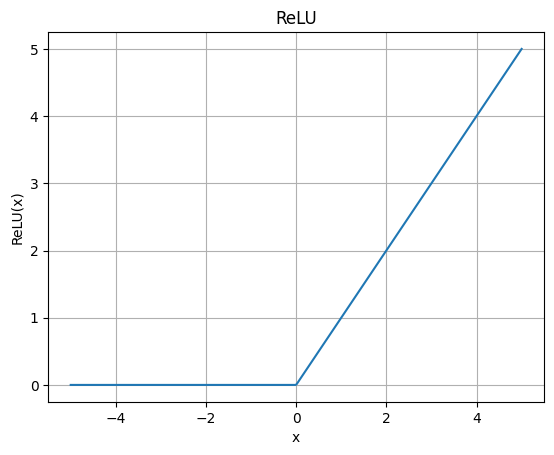

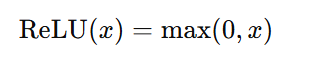

第1位:ReLU(レリュ)

現在、最もスタンダードに使われている王様のような存在です。

- 仕組み入力された値が 0 以下のときは 0 を出力し、 0 を超えたらその値をそのまま出力します。

- 例え「やる気スイッチ」に例えるとわかりやすいでしょう。やる気がマイナスのときは動かず 0 ですが、少しでもプラスになれば、その熱量のまま全力で突き進むイメージです。

数式:

メリット

計算が非常に単純なので、コンピューターに負荷をかけず、学習スピードが圧倒的に速いです。

デメリット

一度値がマイナスに沈みすぎて 0 に固定されてしまうと、二度と学習が進まなくなる死んだニューロン現象が起きることがあります。

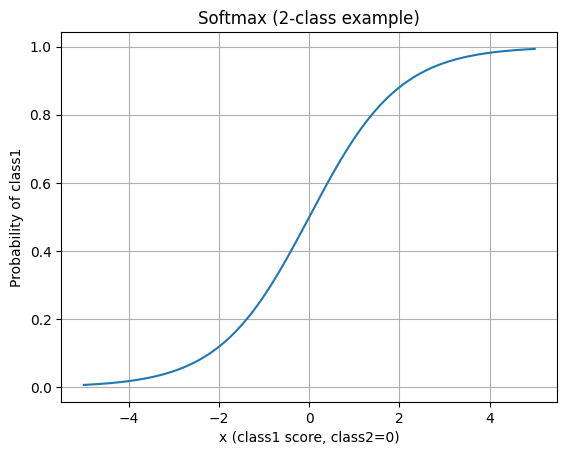

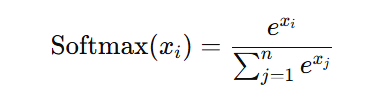

第2位:Softmax(ソフトマックス)

AIに「答え」を出させるとき、最後に必ずと言っていいほど登場する関数です。

- 仕組み複数の出力値の合計が 1 、つまり 100 % になるように調整します。

- 例え「明日の天気の予報」を出すとき、晴れ 80 % 、曇り15 % 、雨 5 % といったように、確率として表現してくれる翻訳機のようなものです。

数式:

メリット

出力が確率として解釈できるため、人間にとって結果が非常に分かりやすくなります。

デメリット

分類問題の最終層以外では使いどころが難しく、途中の層で使うと計算が複雑になりすぎてしまいます。

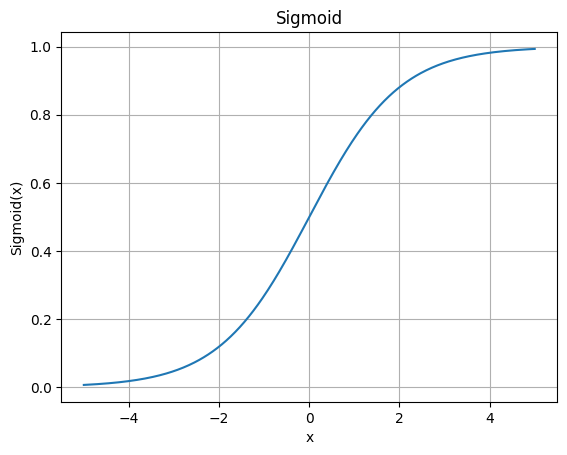

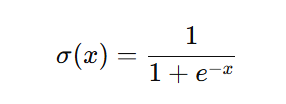

第3位:Sigmoid(シグモイド)

AIの歴史を支えてきた、伝統的な関数です。

- 仕組みどんなに大きな数値や小さな数値が入ってきても、必ず 0 から 1 の間の数値に収めます。

- 例え「0から100までのボリュームつまみ」だと思ってください。どれだけ大声で叫んでも、つまみは 100 で止まり、どれだけ囁いても 0 以下にはなりません。

数式:

メリット

出力が一定の範囲に収まるため、計算が暴走しにくい安定感があります。

デメリット

入力が大きすぎたり小さすぎたりすると、変化がほとんどなくなってしまう勾配消失という問題が起きやすく、深いネットワークの学習には向きません。

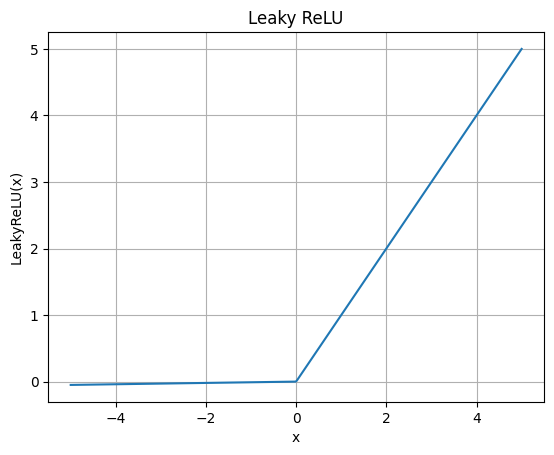

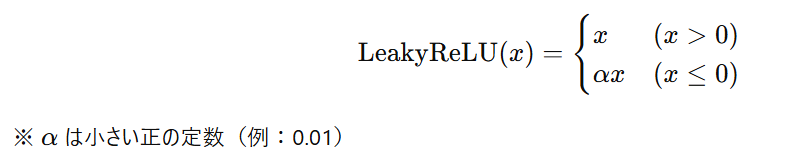

第4位:Leaky ReLU(リーキー・レリュ)

第1位のReLUが抱えていた弱点を克服した改良版です。

- 仕組みマイナスの値が入ってきたとき、完全に 0 にするのではなく、ほんの少しだけ(例えば 0.01倍して)値を通します。

- 例え「完全にシャットアウトしない門番」です。ダメな部下(マイナスの値)でも、完全に切り捨てずに細い糸一本分だけチャンスを残しておく温情派のリーダーですね。

数式:

メリット

ReLUの欠点だった、ニューロンが完全に死んでしまう問題を防ぐことができます。

デメリット

どれくらいマイナスを通すかという設定が必要になり、管理する手間が少し増えます。

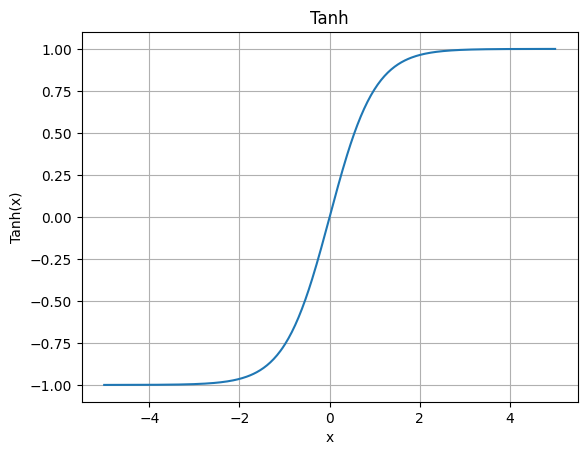

第5位:Tanh(ハイパボリックタンジェント)

シグモイド関数の進化系として知られています。

- 仕組み出力を -1 から 1 の範囲に収めます。

- 例えシグモイドが 0 から 1 だったのに対し、Tanhはマイナス(反対意見)も表現できるようになった拡声器です。

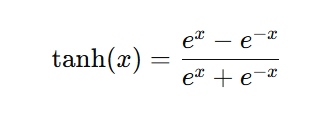

数式:

メリット

データの中心が 0 になりやすいため、次の層の学習がスムーズに進むことが多いです。

デメリット

シグモイド同様、やはり深いネットワークでは学習が止まってしまう性質を持っています。

比較表

紹介した5つの関数の特徴を整理しました。

| 関数名 | 主な用途 | 出力範囲 | 特徴 |

| ReLU | 中間層の標準 | 0 以上 | 高速で高性能 |

| Softmax | 最終層(分類) | 0 から 1 | 合計が 1 になる |

| Sigmoid | 2値分類 | 0 から 1 | 滑らかな変化 |

| Leaky ReLU | ReLUの改良 | 全範囲 | 死なないニューロン |

| Tanh | 中間層 | -1 から 1 | 効率的な学習 |

活性化関数を使いこなすために

ここまで読んでみて、どの関数が一番気になりましたか?

まずは、中間層には迷わずReLUを使い、最後に分類をしたいときはSoftmaxを使うという王道のパターンから始めてみてください。それが、現代のAI開発における最短ルートです。

これからは、実際にPythonなどのプログラミング言語を使って、これらの関数がグラフ上でどのような形をしているか描画してみることをおすすめします。数式がどのように形を変えるのかを目で見ることで、理解はさらに深まるはずです!

次の一歩として、これらの関数を組み合わせた「ニューラルネットワークの構造」について一緒に学んでみませんか?興味があればいつでも教えてくださいね。

セイ・コンサルティング・グループでは新人エンジニア研修のアシスタント講師を募集しています。

投稿者プロフィール

- 代表取締役

-

セイ・コンサルティング・グループ株式会社代表取締役。

岐阜県出身。

2000年創業、2004年会社設立。

IT企業向け人材育成研修歴業界歴20年以上。

すべての無駄を省いた費用対効果の高い「筋肉質」な研修を提供します!

この記事に間違い等ありましたらぜひお知らせください。

学生時代は趣味と実益を兼ねてリゾートバイトにいそしむ。長野県白馬村に始まり、志賀高原でのスキーインストラクター、沖縄石垣島、北海道トマム。高じてオーストラリアのゴールドコーストでツアーガイドなど。現在は野菜作りにはまっている。